Geçtiğimiz yılın son günlerinde Serbestiyet yazıişlerinden arkadaşlar benim o günlerde yayımlanan bir yazımı yapay zekâya sunmuş ve ondan “Bunu Alper Görmüş’ün sesiyle ve tonlamasıyla okur musun” ricasında bulunmuş. Sekiz dakikalık ses kaydını bana gönderip “yayımlayalım mı” diye sordular. Dinledim, “olur” dedim, altına da şöyle yazdım: “Valla çok başarılı. Biraz da ürkütücü. Beni itirafçı terörist olarak da konuşturabilir. Sonra da ayıkla pirincin taşını.” (Bu kayıt, Etyen Mahçupyan’ın bir yazısının ses kaydıyla birlikte daha sonra Serbestiyet’te yayımlandı. Muhtemelen dinleyenler de ürkmüştür benim gibi.)

Acaba yapay zekâ yoluyla birilerini ‘arzu edildiği’ gibi konuşturan ses kaydı üretmenin ‘ayağa düşmesi’ (düşünsenize, yapmanız gereken tek şey bir metin yazmak ve yapay zekâya “bunu şu kişinin sesiyle ve tonlamasıyla oku” komutu vermek) bir yandan da bu yolla tuzağa düşürülenlerin eline kuvvetli bir savunma silahı verir mi? Verebilir. Herkesin bir dakikada üretebileceği bir ses kaydının sahteliğini öne sürmek ve inandırıcı olmak nispeten daha kolay. Neye nispetle? Mesela 10 yıl önceki 17-25 Aralık ses kayıtlarının sahteliğini öne sürmeye nispetle…

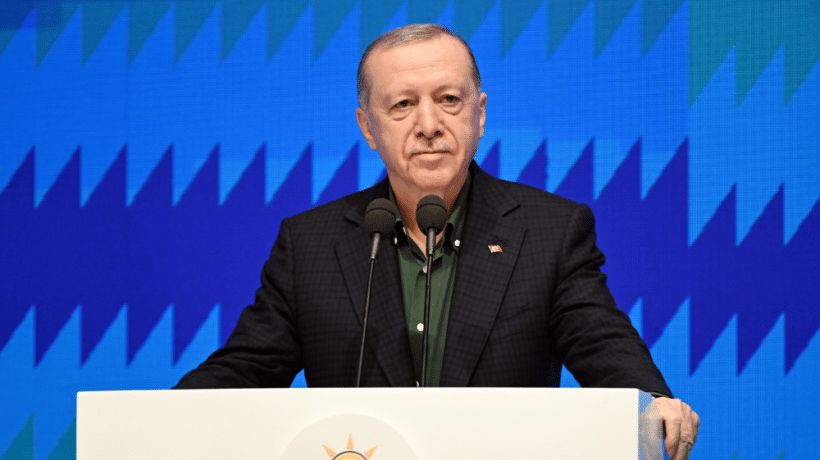

Mesela Başbakan Erdoğan’la oğlu Bilal Erdoğan arasında geçtiği söylenerek yayımlanan ‘sıfırlama’ konulu 10 dakikalık ses kaydının ‘sahte’ olduğunu öne sürmek ve ikna edici olabilmek imkânsıza yakın ölçüde zordu. Ümit Kıvanç, bunun için nasıl bir ‘çalışma’ yapmak gerektiğini, o günlerde bu işin tekniğini inceleyerek şöyle anlatmıştı:

“(…) Buradaki gibi, 10 küsur dakika süren bir konuşmayı, konuşanların başka yerlerdeki sözlerinden kese biçe imal etmek neredeyse imkânsız bir iş. Aslında imkânsız. ‘Neredeyse’ diye ihtiyat kaydı koymam, sadece milyonda bir bunun mümkün olabileceği ihtimalini dışlamamak için. Ama bunun olabilmesi için, hem uygun kelimeleri bulmanız hem de bunların tonlamasının, tansiyonunun birbirini tutması lazım. Meselâ Tayyip Erdoğan’ın halk önündeki konuşmalarından kese biçe, buradaki gibi, ahizeye kapanmış halde, kısık sesle sürdürülen bir konuşma imal edemezsiniz. Bir basın toplantısındaki konuşmasından üç kelimeyle, bir mitingteki dört kelimesini biraraya getirip cümle üretemezsiniz. Sürat ve frekansla biraz oynayabilirsiniz, ama söyleyiş tarzında bariz farklılıklar varsa, bunu dinleyenler kolaylıkla ayırt edebilir.

“Otomatik cevap cihazlarının her seferinde değişen numaraları araya koyarak kurdukları cümleleri düşünün: ‘(Akıcı:) Sayın abonemiz, eğer alan kodunuz… (gereksiz boşluklarla, dura dura:) iki… yüz… on… altı… (akıcı:) ise, lütfen…’ Bunlardaki yapaylığı nasıl hemen ayırt ediyoruz? İşte öyle…”

Şimdi “E, kardeşim, öyle diyorsun da o zaman da kaydın sahte olduğu ‘kolayca’ öne sürülmedi mi” diyecekler tamamen haklı. Onlara cevabım şöyle: Doğru, öyle oldu ama burası Türkiye olduğu için öyle oldu. (Ya da: Doğru, öyle oldu ama konuşanlar muhalefet lideriyle oğlu olmadığı için öyle oldu.)

Teknolojinin sunduğu imkânlar iki seçim arasında bu kadar artmışken trollerimiz uyuyor mu? Bu defa muhalefetten neden ‘dikkat’ uyarıları gelmiyor?

14-28 Mayıs 2023 seçimlerinin üzerinden neredeyse bir yıl geçti ve bu arada başta yapay zekâdaki sıçramalı ilerlemeler olmak üzere digital teknolojideki gelişmeler sahtegerçek üretimi sektörünün eline çok sayıda ilave imkân sundu. Ne var ki, Türkiye yeni bir seçime giderken iktidar kanadından bu imkândan faydalanma yönünde bir eğilim göremiyoruz. Yine muhalefet kanadından bu yönde hiçbir uyarının gelmemesi de ilginç. Oysa tablo, 14-28 Mayıs seçimleri öncesinde hiç böyle değildi. Hatırlayalım:

Önce muhalif medyada “Kılıçdaroğlu’na, söylemediği şeyleri söyleten (deep fake) videolar mı geliyor?” başlıklı bir tartışma açıldı. Ardından, seçime 12 gün kala (2 Mayıs) Kemal Kılıçdaroğlu’ndan çok ilginç bir uyarı geldi:

“Son 10 güne 2 gün kaldı. Ben son uyarımı yapayım. Fahrettin Altun, Serhat ve ekip arkadaşları Çağatay ile Evren; anlaşmaya çalıştığınız dark web dünyası, sizi yabancı istihbaratın eline düşürür. Cambridge Analytica’cılık oynamak sizin kapasitenizi aşar çocuklar. SON UYARIMDIR!”

Kılıçdaroğlu’nun uyarılarını Selahattin Demirtaş’ınkiler izledi:

“Ciddi manipülasyon ve algı operasyonları gelecek gibi görünüyor. Tanımadığınız ya da trol olduğu belli olan veya iktidar çevrelerinin hesaplarından yayılan hiçbir şeyi, LÜTFEN GÖRMEYİN, DUYMAYIN, YAYMAYIN VE PAYLAŞANLARI ENGELLEYİN. Size güveniyorum.”

Gazeteci Murat Yetkin de 3 Mayıs tarihli yazısında CHP kulislerine dayanarak yeni bilgiler verdi. Yetkin, “Kılıçdaroğlu’nun son on gün uyarısı ve ‘deep fake’ istihbaratı” başlıklı yazısında, üstü düzey CHP yöneticilerinin kendisine söylediklerini aktardı. Bunlardan birinde şöyle deniyordu:

“(…) Kampanyanın asıl hedefiyse Kılıçdaroğlu: amaç Kılıçdaroğlu’nu Erdoğan’ın seçim kampanyasında kullanabileceği kişilerle görüşmüş, söylemediği şeyleri söylemiş gibi ses ve görüntü kayıtları üretip bunları hedef internet kullanıcılarına göndererek seçim sonuçlarına müdahale etmek.”

14 Mayıs’a kadar bu uyarıları haklı çıkartacak bir gelişme olmadı. Kimbilir, belki de CHP’nin ve Kılıçdaroğlu’nun yürüttüğü uyarı ve açığa çıkarma kampanyaları etkili olmuş, planlanan bazı faaliyetlerin yürürlüğe konmasından vazgeçilmişti.

Ya da belki “lüzum yok böyle sofistike şeylere, ‘bizim çocuklar’ın hazırlayacağı amatör işlerle aynı faydalı sonucu elde edebiliriz” denmiş ve bu doğrultuda mesela CHP’nin seçim şarkısı ‘Haydi’ye el çırparak eşlik eden Kılıçdaroğlu görüntüsünün fonuna bir de başka bir şeye el çırpan Murat Karayılan’ın görüntüsünü yerleştirmekle iktifa edilmişti.

Sonrasında bu montaj videonun ‘deep fake’ yöntemiyle oluşturulduğu gibi haberler, yorumlar izledik. Bunlar yanlıştı. Deep fake, fotoğraftan, hatta tablodan video üretimini mümkün kılan bir teknoloji. Birinin fotoğrafını alıyorsunuz, ondan bir video üretiyorsunuz ve ağzına da istediğiniz lafı veriyorsunuz; hem de kendi sesiyle ve tonlamasıyla.

Yapay zekânın geldiği seviyede hiç şüphesiz deep fake videolarının inandırıcılık düzeyinde büyük bir ilerleme kaydedilmiş olmalı. Fakat zaten bu digital tekniğin dört-beş yıl önceki hali bile yeterince ikna ediciydi. Ben mesela, üretilen ve yayımlanan deep fake videolarından yola çıkarak daha o zaman şöyle bir örnekle anlatabilmiştim durumu:

“Kendinizi bir an için ünlü bir siyasetçi olarak düşünün… İnternette, 10 yıl önce basına kapalı bir toplantıda yaptığınız bir konuşmanın kaydı olduğu söylenen bir videoyla karşılaştınız… O konuşmada neler söylediğinizi hatırlıyorsunuz, fakat videoda ne o gün ne de bugün asla dile getirmeyeceğiniz fikirleri art arda sıralıyorsunuz.

“Videoyu izlerken, kendi kendinize sorduğunuz bütün sorulara ‘evet’ cevabı veriyorsunuz: Evet, bu benim 10 yıl önceki halim… Evet, sesim aynı… Evet, dudak hareketleriyle sesler arasında hiçbir uyumsuzluk yok… Evet, bu konuşan benim, fakat hayır, ben asla bu cümleleri kurmamıştım.

“Doğru, kurmamıştınız ama, muhtemel tekzipleriniz muhtemelen sadece o gün o toplantıda sizi dinleyenleri ikna etmede işe yarayacak. Geri kalanların size düşman olanları videonun sahte olma ihtimalini hesaba katmayıp ânında sizi gömecek, sizi sevenler de ölümcül bir ikilemle karşı karşıya kalıp kendilerine şu soruyu soracak: ‘Acaba izlediğim video bir ‘deep fake’ (derin sahtelik) üretimi mi, yoksa bizim adam gerçekte bu muymuş?’”

14-18 Mayıs seçimlerinde olmayan, şimdi olur mu?

Önümüzdeki Pazar seçim var. Yukarıda da dediğim gibi muhalefetten bu yönde hiçbir uyarı gelmiyor. İki nedeni olabilir bunun: Bu defa gerçekten de kuşkulu istihbari bilgiler almamış olabilirler ya da “geçen seçimde yapmadılar demek ki niyetleri yok” rahatlığıyla hareket ediyor olabilirler.

Dileyelim böyle bir şeye tevessül edilmesin, fakat varsa bir hazırlık, bunun -maç spikerlerinin klişesiyle- “telafisi mümkün olmayan dakikalarda”, yani seçimden önceki son bir-iki günde sahaya sürüleceğini tahmin etmek zor değil.

İktidar mensuplarının kendileri hakkında böyle kuşkuların dile getirilmesine alınma, kızma hakları yok. Bunu son seçimde amatörce yaptılar, şimdi de profesyonelce yeni bir atak geliştirmelerinin ihtimal dahilinde olduğunu düşünme hakkımız var.

Yazıyı beğendiysen, patronumuz olur musun?

Evet, çok ciddi bir teklif bu. Patronumuz yok. Sahibimiz kar amacı gütmeyen bir dernek. Bizi okuyorsan, memnunsan ve devam etmesini istiyorsan, artık boş olan patron koltuğuna geçmen lazım.

Serbestiyet; Türkiye'nin gri alanı. Siyah ve beyazlar içinde bu gri alanı korumalıyız. Herkese bir gün gri alanlar lazım olur.